轉載從: Tech News 科技新報

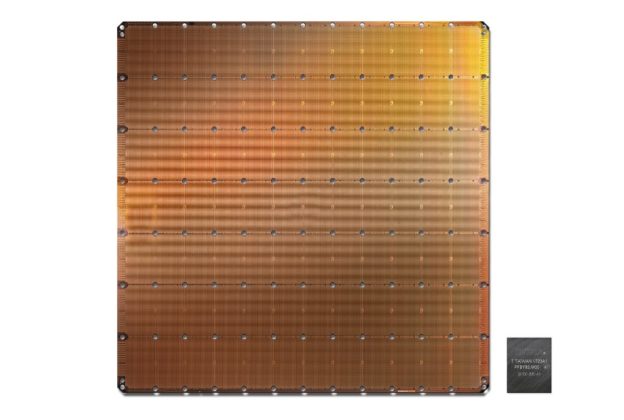

位於加州的新創獨角獸公司 Cerebras 於 19 日公布據稱是世界最大的電腦晶片──晶圓級引擎(Wafer-Scale Engine,WSE),以及有關這片保密約 3 年之久的晶圓級 AI 晶片細節。儘管仍有許多懸而未決的問題,但這種新方法可能標誌半導體產業的重要里程碑,畢竟在這個產業,歷來就受單一晶片遮罩尺寸的限制。

由 Cerebras 設計的 WSE 晶片外觀尺寸比標準 iPad 稍大。Cerebras 表示,從自駕車到監控軟體,單一晶片就能驅動複雜的 AI 系統。然而某專家卻表示,在許多資料中心裡,安裝這種創新證實是不切實際。

Cerebras 設計了一個由 84 顆互連晶片組成的晶圓,以當作用於計算與記憶體儲存的裝置,並由超高速晶粒結構(ON-die Fabric)互連。雖然在晶片上打造一個超級電腦聽起來是個極棒的主意,但製造晶圓級的晶片陣列並不適合膽小或才智一般的人。

此外,如果 Cerebras 的方向及做法是對的,那麼 AI 可能只是晶圓級整合的開始;因為目前應用程式對效能的要求愈來愈高,並超過 CPU 能提供的效能。如果 Cerebras 完成第一個 AI 導向實作後,能將注意力轉向浮點運算核心,那麼晶圓級方法就可能徹底改造當前的高效能運算。

Cerebras 內含 400,000 顆核心,以台積電嫻熟 16 奈米製程為後盾

Cerebras 是由現任硬體架構師的 Sean Lie 和曾經擔任微伺服器新創公司 Sea Micro(2011 年被 AMD 購併)創辦人兼執行長與現任執行長的 Andrew Feldman共同創辦。Feldman 的新公司現在僱用近 200 名工程師,其中許多人都是 Sea Micro 的舊員工。Cerebras 已募集逾 1.2 億美元資金,最近的市場估值達 8.6 億美元。當大多數 AI 半導體新創公司專注於構建適用執行深度神經網路所需矩陣和向量處理的更高效運算核心陣列和晶片內記憶體(On-chip Memory)時,Cerebras 決定直接跳過數學優化,反而全心全意努力實現極端的可擴展性。

如同百度資深研究人員 Greg Daimos 所言,在超大資料集訓練大型模型將花費數月或數年的關鍵路徑(Critical Path)運算時間,這使這類訓練對現有系統的任何真實世界問題都不切實際。但 Cerebras 宣稱,其 WSE 晶片能將複雜資料的處理時間,從幾個月降低到幾分鐘。

目前最強的桌上型電腦使用 CPU 約有 30 顆運算核心,至於功能最強大的 GPU 有多達 5,000 顆核心。Cerebras 推出的新晶片內含 400,000 顆核心,所有核心皆透過高頻寬連接相互鏈結。Cerebras 表示,這使它在處理複雜的機器學習挑戰方面更具優勢,與其他方案選項的組合相比,延遲更小、功耗更低。

Feldman 表示,Cerebras 已「克服了幾十年來一直讓晶片尺寸受到限制的技術挑戰」,他更進一步指出,訓練學習時間的減少,更將整個產業進展的一大瓶頸徹底消除。目前 Cerebras 已開始供貨給少數客戶,但尚未透露晶片的價格。

Cerebras 在本週於史丹佛大學舉行的年度 Hot Chip 大會,分享了一些設計細節。晶片是由台積電採用成熟 16 奈米製程打造的 300mm 晶圓切割而成。以下列舉元件的基本規格:

- 2 兆顆電晶體

- 46,225mm2 晶矽

- 400,000 顆 AI 可程式核心

- 18GB 超快晶粒內記憶體(SRAM)

- 9 PB/s 記憶體頻寬

- 100 PB/s Fabric 頻寬

- 稀疏性本地最佳化(避免乘以零)

- 支援與 TensorFlow 與 PyTorch 等標準 AI 框架的軟體相容性

- Cerebras Unveils AI Supercomputer-On-A-Chip

- Cerebras reveals world’s ‘largest computer chip’ for AI tasks

(首圖來源:Cerebras)